W świecie finansów i technologii, proces “know your customer” (KYC) to fundament bezpieczeństwa i zaufania. Banki i fintechy, takie jak Wise czy Revolut, od lat polegają na zdjęciach dowodów tożsamości i selfie do weryfikacji tożsamości swoich klientów. Jednakże, rosnąca potęga generatywnej AI może postawić pod znakiem zapytania skuteczność tych metod. Czy jesteśmy świadkami zmierzchu epoki tradycyjnego KYC?

Proces KYC w obliczu nowoczesnych technologii

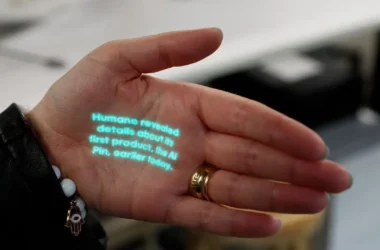

KYC to nie tylko formalność – to klucz do bezpieczeństwa w cyfrowym świecie. Proces ten wymaga od klientów przedstawienia dowodów tożsamości, które są następnie weryfikowane przez instytucje finansowe. Zdjęcia dowodów i selfie są krzyżowo sprawdzane, aby zapewnić, że osoba ubiegająca się o usługę jest rzeczywiście tym, za kogo się podaje. To właśnie te zdjęcia stają się teraz celem ataków z użyciem generatywnej AI.

Generatywna AI może manipulować obrazami, co stawia pod znakiem zapytania bezpieczeństwo weryfikacji. Wyobraźmy sobie atakującego, który pobiera selfie ofiary, edytuje je przy użyciu narzędzi AI i tworzy fałszywe zdjęcie, które pomyślnie przechodzi przez test KYC. Chociaż na razie nie ma dowodów na to, że takie zdarzenia mają miejsce, możliwość tworzenia przekonujących deepfake’ów jest niepokojąca.

AI will rapidly accelerate broad use of private key cryptography and decentralized ID.

— Justin Leroux (@0xMidnight) January 5, 2024

Check out this Reddit "verification post" and ID made with Stable Diffusion. When we can no longer trust our eyes to ascertain whether content is genuine we'll rely on applied cryptography. pic.twitter.com/6IjybWRhRa

Złodzieje tożsamości nie są nowym zjawiskiem, ale generatywna AI otwiera przed nimi nowe możliwości. Od lat fałszerze sprzedają skradzione lub podrobione dowody tożsamości i selfie. Teraz jednak, dzięki generatywnej AI, mogą tworzyć jeszcze bardziej przekonujące falsyfikaty, które mogą z łatwością wprowadzić w błąd systemy KYC.

Wyzwania i luki w obecnych systemach bezpieczeństwa

Tworzenie realistycznych obrazów ID staje się coraz łatwiejsze. Kiedyś wymagało to zaawansowanej wiedzy z zakresu edycji zdjęć, teraz jednak bariery wejścia są znacznie niższe. Dostępne są darmowe, open source’owe generatory obrazów, które mogą być wykorzystane do tworzenia syntetycznych wizerunków osoby na dowolnym tle.

Aplikacje mogą być oszukane do akceptowania deepfake’ów zamiast rzeczywistego obrazu z kamery. To możliwe dzięki emulatorom pulpitu i wirtualnemu oprogramowaniu do obsługi kamery. Co więcej, niektóre platformy implementują testy “żywotności”, które wymagają od użytkowników nagrania krótkiego wideo, aby udowodnić, że są prawdziwi. Jednak nawet te środki bezpieczeństwa można obejść przy użyciu narzędzi AI.

NEWS: Our latest research is out!

— Sensity (@sensityai) May 18, 2022

We found that 10 of the most popular biometric KYC providers are severely vulnerable to realtime deepfake attacks. And so may be your bank, insurance or health providers

Full report at https://t.co/vryGJ7na0ihttps://t.co/VVaSZrCZRn

Bezpieczeństwo wymaga ciągłej ewolucji w odpowiedzi na postępujące technologie. Główny dyrektor ds. bezpieczeństwa giełdy kryptowalut Binance wspomniał, że dzisiejsze narzędzia do tworzenia deepfake’ów są w stanie przejść testy żywotności. Jeśli tendencja ta się utrzyma, KYC, które i tak nie zawsze jest niezawodne, może stać się zupełnie nieskuteczne jako środek bezpieczeństwa.

Implikacje dla przyszłości weryfikacji tożsamości

Potencjalne zagrożenia związane z manipulacją obrazami ID wymagają uwagi. W miarę jak narzędzia generatywnej AI stają się coraz bardziej dostępne i zaawansowane, musimy zastanowić się, jak zapewnić bezpieczeństwo procesów KYC. To nie tylko kwestia technologii, ale także przepisów prawnych i współpracy międzynarodowej.

Musimy być o krok przed oszustami. Wdrożenie bardziej zaawansowanych metod weryfikacji, takich jak biometria behawioralna, może okazać się konieczne. Nie możemy pozwolić, by technologia, która miała służyć poprawie naszego życia, stała się narzędziem do łamania prawa i narażania nas na ryzyko.

Świadomość jest kluczem do ochrony naszej tożsamości. Jako użytkownicy, musimy być świadomi potencjalnych zagrożeń i chronić nasze dane osobowe. Instytucje finansowe i technologiczne muszą z kolei inwestować w rozwój bezpieczniejszych systemów weryfikacji. Tylko w ten sposób możemy zapewnić, że proces KYC pozostanie skutecznym narzędziem w walce z oszustwami finansowymi i kradzieżą tożsamości.